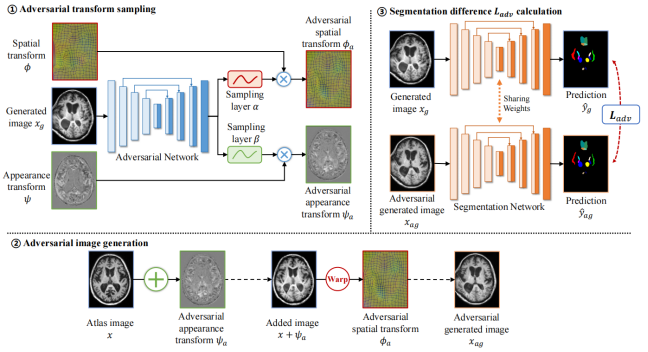

在腦影像分割領域,張立箎課題組發表的論文為One-Shot Traumatic Brain Segmentation with Adversarial Training and Uncertainty Rectification[1]。顱腦創傷(traumatic brain injuries, TBI)指的是因為外力作用於頭顱及其內容物而引起的大腦損傷。隨著現代放射學影像技術的發展🤨,磁共振成像(magnetic resonance imaging, MRI)等技術已經被廣泛應用於顱腦創傷患者的診斷𓀛、治療與預後。然而,影像學分析需要事先獲取與意識水平相關腦區的分割信息👩💻,以此實現對患者的腦損傷及意識水平評估。在實際臨床工作中👨🏼🎤,我們往往只能獲取到少量的標註圖像,大量顱腦創傷患者的MR圖像並沒有得到相關標註。為了解決上述關於顱腦創傷患者腦區分割中數據不足的問題,課題組提出了一種基於對抗訓練與不確定性校正的單樣本(one-shot)分割算法。該算法在現有的基於學習變換的單樣本分割(one-shot segmentation based on learned transformations, OSSLT)算法的基礎上🧜🏼🙆🏽,通過在數據增強中引入對抗訓練以提升數據擴增的多樣性和分割算法的穩健性🫱,並通過不確定性校正減輕數據擴增時顱腦創傷患者腦影像中存在的血腫、占位等因素對腦區標註的影響。該方法在合作單位上海華山醫院的顱腦創傷患者腦MR數據集上進行了驗證,其對比同類算法取得了最優的性能♐️。該論文的源代碼已

在網上開源發布:https://github.com/hsiangyuzhao/TBIOneShot

圖 1 引入對抗訓練與不確定性校正策略的單樣本重型顱腦創傷影像分割方法

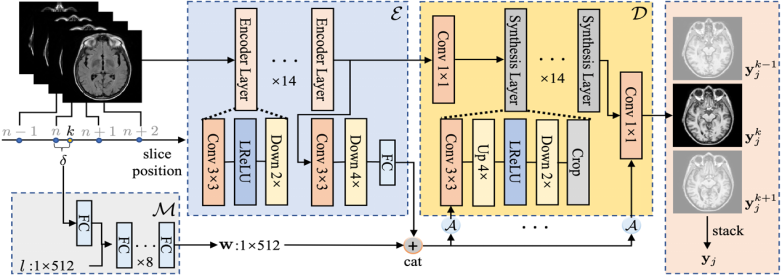

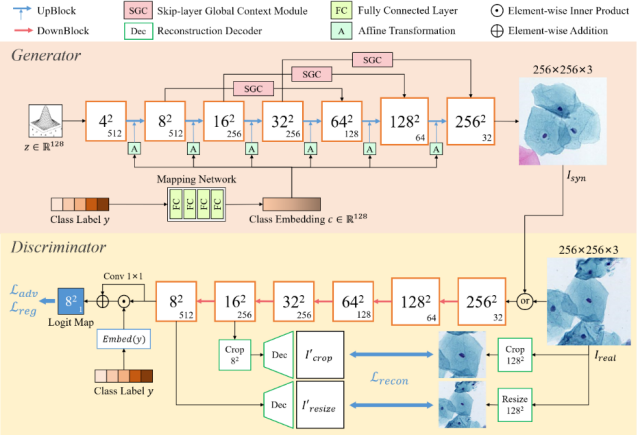

在醫學圖像生成方向🙅♀️,張立箎課題組發表的論文為Alias-Free Co-Modulated Network for Cross-Modality Synthesis and Super-Resolution of MR Images[2]。針對提高現有的MRI成像質量的臨床需求🔇,目前已經有大量面向跨模態合成(CMS)👂🏻、超分辨率(SR)及跨模態超分辨率(CMSR)任務的算法研究🕡。大多數針對CMS任務的研究都是通過模態不變和一致的高頻細節實現在不同模態之間的模態轉換,而針對SR和CMSR任務的研究通常被設計為應用於3D模型構建的重建算法。然而上述工作存在兩個主要局限性問題:一方面,這些工作局限於特定領域,無法靈活地轉換到其他任務應用中🔍。另一方面,在這些生成網絡往往無法處理圖像中的高頻細節信息,以此導致不自然的細節甚至混疊偽影。為了靈活地完成CMS,SR及其組合任務,課題組提出全新的MR影像生成方法AFCM(Alias-Free Co-Modulated Network)🆔🃏,能夠同時實現對目標影像的多種生成任務。首先🤲🏻,該方法構建了聯合調製(co-modulation)策略,其將基於風格的調製與圖像條件和位置編碼相結合♋️,以確保這些任務之間的一致性🍣。該策略還通過使用連續的位置嵌入在任意位置重構切片,實現了更靈活的SR。此外,AFCM方法在生成器中的離散算子進行了重新設計,使其在Shannon-Nyquist信號處理框架下保證無混疊(alias-free)。該方法在MRI圖像跨模態合成、超分辨率、以及跨模態超分辨率任務上均取得最佳性能,體現出AFCM在不同任務上的靈活性和優越性。該論文的源代碼已在網上開源發布👰:https://github.com/zhiyuns/AFCM。

圖 2 基於抗混疊聯合調製(AFCM)的MR圖像重建算法

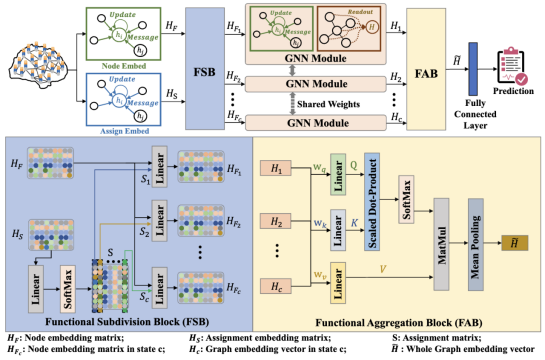

在腦影像分析方向🎋,張立箎團隊共發表了兩篇論文🧑🏻🤝🧑🏻🧵。其中第一篇為Learnable Subdivision Graph Neural Network for Functional Brain Network Analysis and Interpretable Cognitive Disorder Diagnosis[3]🙇🏼。大腦的不同功能配置🦹🏼,也被稱為“大腦狀態”,反映了一系列連續的大腦認知活動。這些不同的大腦狀態賦予了大腦網絡豐富多樣的功能。最近的研究表明🪡🔔,從腦功能網絡中提取信息有利於腦神經科學的分析以及相應的大腦疾病診斷🚬。與此同時,圖神經網絡(GNN)也被證明在學習腦網絡表示(brain network representation)方面具有優勢🥿,且廣泛的應用於腦網絡分析中。然而,這些基於GNN的方法很少關註大腦網絡的異質性🟣,特別是由內在大腦狀態引起的大腦網絡功能方面的異質信息🤪。為解決上述關於腦網絡異質功能信息提取方面存在的難題🐳,該論文提出了一種用於腦網絡分析的可學習細分圖神經網絡(LSGNN)。該方法的核心思想是實現一種可學習的細分策略,將大腦網絡編碼到與功能狀態相對應的多個潛在特征子空間,並分別在每個子空間下實現大腦網絡的特征提取🖨。此外🛳,考慮到大腦狀態之間復雜的相互作用,該論文提出的方法還利用自註意力機製在聯合潛在空間中獲得全面的大腦網絡表示信息,最終實現在認知障礙疾病上的診斷及相應的可解釋分析。該論文的源代碼已在網上開源發布:https://github.com/haijunkenan/LSGNN🧎🏻🤞🏽。

圖 3 LSGNN框架概述,該框架由用於可學習細分功能嵌入的FSB模塊以及用於綜合腦網絡表示的FAB模塊組成

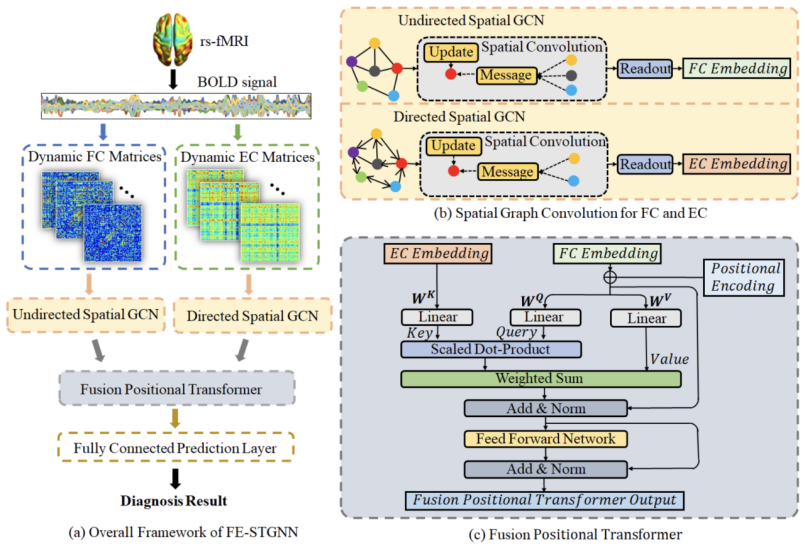

張立箎團隊在腦影像分析領域發表的第二篇論文為FE-STGNN: Spatio-Temporal Graph Neural Network with Functional and Effective Connectivity Fusion for MCI Diagnosis[4]。大腦連接模式,如功能連接(FC)和有效連接(EC)🧔♀️,描述了大腦網絡中復雜的時空動態相互作用🤬,這能夠應用於輕度認知障礙(MCI)的診斷中。目前主要的功能連接方法基於統計依賴性🚴🏿♀️,通常根據相關性進行評估,而有效連接通常關註大腦區域之間的定向因果影響👩💻。因此,功能連接和有效連接互補信息的全面整合可以進一步提取表征大腦異常的重要生物標誌物。為此該論文提出了一種具有動態功能連接和有效連接融合的時空圖神經網絡(FE-STGNN)🏃♀️,其首先構建了動態的功能連接和有效連接網絡,將功能性腦網絡編碼為多個圖🥬。然後👊,利用空間圖卷積處理空間結構特征和時間動態特征🩸。最後,該方法還設計了基於位置編碼的交叉註意力機製,利用有效連接在時間進化過程中的因果聯系來指導功能連接網絡的融合。該論文提出的方法在輕度認知障礙疾病診斷任務上達到了目前領先的性能,其源代碼已在網上開源發布:https://github.com/haijunkenan/FE-STGNN。

圖 4 FE-STGNN模型圖解。(a)是所提出方法的總體框架🤵🏿♀️🐸。(b)從紅色節點的角度描述了動態功能連接和有效連接網絡的空間圖卷積的詳細過程🧑🏽🍳。(c)描述了功能連接如何在有效連接的指導下基於註意力機製聚合信息🍮🧑🏼🦱。

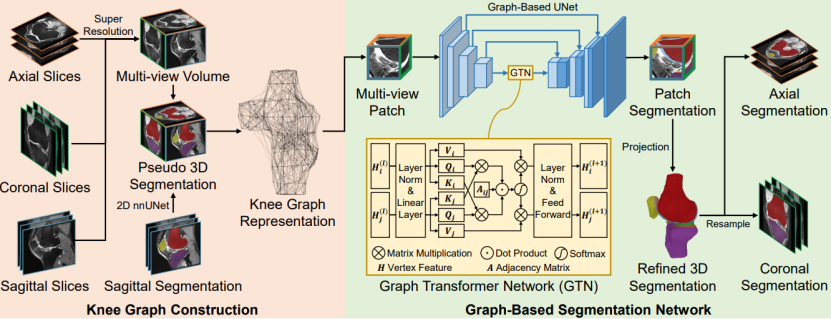

在骨關節影像分析領域,張立箎研究團隊發表的論文為CAS-Net: Cross-view Aligned Segmentation by Graph Representation of Knees[5]🥸。該論文提出了一種稱為CAS-Net新的框架,目的是從臨床常規的多視圖2D MRI圖像生成3D膝關節組織的分割。MRI在臨床檢查膝關節時起到了重要作用,但3D成像需要長時間掃描,而多視圖2D掃描可以較快得到足夠細節信息。然而🐩👰🏼,如何充分利用多視圖2D圖像獲取3D分割至今仍是一個挑戰。CAS-Net框架首先通過深度學習方法對多視圖2D圖像進行超分辨率重建🏋️,並將其統一到等距3D空間🐍。然後👮🏿♂️,該方法基於圖表示法提取位於關節之間的多視圖圖塊信息😋,並以此構建包含節點和邊的膝關節圖表示網絡。隨後,CAS-Net利用基於圖的卷積神經網絡對每個圖塊進行分割,最後通過節點連接將其組合成3D分割結果。在OAI數據集上進行實驗驗證時,CAS-Net僅使用矢狀位分割標註就能從多視圖2D圖像中生成平均86.0%的3D膝關節分割準確率𓀙,在骨組織上區域的分割性能優於使用完整3D圖像標註訓練的分割模型。實驗結果證明CAS-Net通過基於多視圖間的一致性信息實現了從臨床2D到能用於復雜分析的3D分割👨🏻🦲,並展示出該新框架在醫學圖像分析領域的重要應用潛力👮♂️🧑🏻🦽。

圖 5 多視圖對齊分割網絡(CAS-Net)的整體框架,主要包括兩個部分💂🏼:(1) 膝關節圖表示構建🧑🏿🦳,包含將多視圖2D掃描進行超分辨率重建為3D體積過程👨🏻💻🆚,並用膝關節圖(Graph)進行表示。(2) 基於圖的分割網絡,它對膝關節圖上的圖塊進行分割以得到3D分割結果🟣。

在醫學病理圖像生成方向🔠,張立箎團隊發表的論文為CellGAN: Conditional Cervical Cell Synthesis for Augmenting Cytopathological Image Classification[6]。宮頸細胞病理學自動篩查模型通常需要大量、多樣且類別平衡的標註數據進行訓練。然而由於存在醫療數據隱私保護強和專家標註成本高等原因,在臨床實際中難以構造高質量的標註數據集🤮🍪。針對這一行業痛點,該論文提出CellGAN生成模型🦻🏽👳♂️,其通過生成式的數據增強方案來解決標註數據稀缺的難題🔰。在建模過程中,該論文主要針對細胞病理學圖像生成任務中的三點挑戰提出了對應的設計思路:第一,數據增強需求源於標註數據的稀缺,但在數據稀的情況下也難以訓練出高質量的生成模型。對此👮🏻♀️,CellGAN采用輕量級的FastGAN作為主幹網絡🧱,保證少樣本圖像生成的訓練穩定🗳。第二⬆️,不同類別的細胞之間存在形態差異,但部分細胞類別之間差異細微💆、不易區分🚴♂️🤵🏿♀️。對此,CellGAN生成器引入類別映射網絡(Class Mapping Network)來完成細胞類別條件的多尺度調控,實現細胞類別特征的精準建模。第三🤍,宮頸細胞在細胞病理學圖像中的空間分布完全隨機📀,細胞之間存在相隔很遠🫧、緊挨一起、互相重疊等復雜情況。對此,CellGAN在生成器中構造了躍層全局上下文模塊(Skip-layer Global Context Module)🃏👮🏻♀️,將低尺度特征圖的全局上下文信息融合到較高尺度的特征圖中🔻,實現細胞復雜空間關系的精準建模。在生成圖像質量評估實驗中,CellGAN生成的宮頸細胞病理學圖像質量超過了BigGAN和Latent Diffusion Model等SOTA生成模型。在數據增強效果評估實驗中😚,該論文證明了CellGAN生成數據對不同架構的篩查模型都能起到有效的性能增強作用👱🏽♂️。該論文的源代碼

已在網上開源發布:https://github.com/ZhenrongShen/CellGAN🚕。

圖 6 用於病理圖像重建任務的CellGAN方法框架,可實現對多種宮頸病變細胞和正常鱗狀上皮細胞的圖像生成工作。

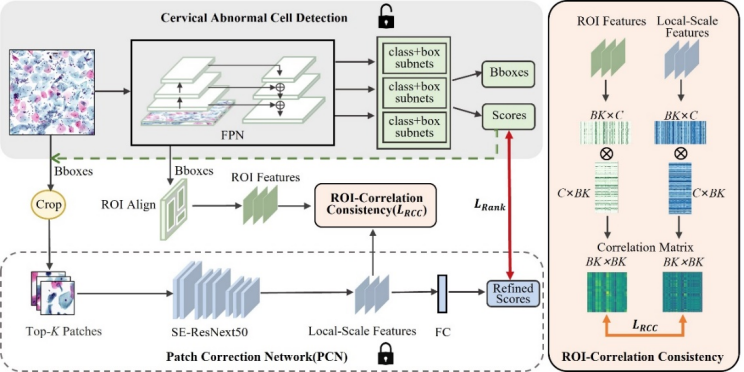

在醫學病理圖像診斷方向➿,張立箎團隊發表的論文為Robust Cervical Abnormal Cell Detection via Distillation from Local-Scale Consistency Refinement [7]🚵🏻。高效的計算機輔助診斷系統在宮頸異常篩查中的應用對於其檢測宮頸病變異常及促進早期治療至關重要📤🤿。然而😪🪲,由於細胞學家在標註訓練樣本時存在主觀差異🪘,檢測性能往往受到訓練數據集中噪聲樣本的影響🥜。此外💥,現有的檢測方法往往忽略了細胞間的視覺特征相關性信息,而這些信息對於細胞檢測十分重要。為解決這些問題🧦,該論文提出了一種基於局部尺度一致性的蒸餾策略優化的宮頸異常細胞檢測方法🛰。該方法基於RetinaNet模型檢測出前K個可疑細胞🔻,並提取對應的感興趣區域(ROI)特征。然後,利用預訓練的Patch Correction Network獲取局部尺度特征和分類得分,並對這些可疑細胞的檢測得分進行修正👨🏽🏭。該論文同時提出了一個分類排序損失函數,並基於分類得分實現蒸餾學習以減小噪聲標簽對檢測模型造成的影響👳🏻♀️。此外,該論文還設計了一個提取ROI特征和局部尺度特征之間的感興趣區域-相關性一致性損失函數🚼,並利用相關性信息優化檢測網絡。實驗證明該蒸餾方法能夠在推理過程中能夠顯著增強宮頸異常細胞檢測的性能,與目前最先進的檢測方法相比展現出了優越性👱🏽♀️。該論文的源代碼已在網上開源發布🦹🏻♂️:https://github.com/feimanman/Cervical-Abnormal-Cell-Detection👱🏿♀️➝。

圖 7 基於局部尺度一致性的蒸餾框架,通過基於PCN構件測分類網絡,實現對宮頸病變細胞檢測模型的優化工作,並有效提升其檢測性能。

論文信息

1. Xiangyu Zhao, Zhenrong Shen, Dongdong Chen, Sheng Wang, Zixu Zhuang, Qian Wang, Lichi Zhang*, “One-Shot Traumatic Brain Segmentation with Adversarial Training and Uncertainty Rectification,” in International Conference on Medical Image Computing and Computer Assisted Intervention (MICCAI), 2023 (early accept).

2. Zhiyun Song, Xin Wang, Xiangyu Zhao, Sheng Wang, Zhenrong Shen, Zixu Zhuang, Mengjun Liu, Qian Wang, Lichi Zhang*, “Alias-Free Co-Modulated Network for Cross-Modality Synthesis and Super-Resolution of MR Images,” in International Conference on Medical Image Computing and Computer Assisted Intervention (MICCAI), 2023 (early accept).

3. Dongdong Chen, Mengjun Liu, Zhenrong Shen, Xiangyu Zhao, Qian Wang, and Lichi Zhang*, “Learnable Subdivision Graph Neural Network for Functional Brain Network Analysis and Interpretable Cognitive Disorder Diagnosis,” in International Conference on Medical Image Computing and Computer Assisted Intervention (MICCAI), 2023.

4. Dongdong Chen, and Lichi Zhang*, “FE-STGNN: Spatio-Temporal Graph Neural Network with Functional and Effective Connectivity Fusion for MCI Diagnosis,” in International Conference on Medical Image Computing and Computer Assisted Intervention (MICCAI), 2023.

5. Zhenrong Shen, Maosong Cao, Sheng Wang, Lichi Zhang, Qian Wang*, “CellGAN: Conditional Cervical Cell Synthesis for Augmenting Cytopathological Image Classification,” in International Conference on Medical Image Computing and Computer Assisted Intervention (MICCAI), 2023 (early accept).

6. Zixu Zhuang, Xin Wang, Sheng Wang, Zhenrong Shen, Xiangyu Zhao, Mengjun Liu, Zhong Xue, Dinggang Shen, Lichi Zhang*, Qian Wang*, “CAS-Net: Cross-View Aligned Segmentation by Graph Representation of Knees,” in International Conference on Medical Image Computing and Computer Assisted Intervention (MICCAI), 2023

7. Manman Fei, Xin Zhang, Maosong Cao, Zhenrong Shen, Xiangyu Zhao, Zhiyun Song, Qian Wang, Lichi Zhang*, “Robust Cervical Abnormal Cell Detection via Distillation from Local-Scale Consistency Refinement,” in International Conference on Medical Image Computing and Computer Assisted Intervention (MICCAI), 2023